Naukowcy z WEF stworzyli chatboty oparte na sztucznej inteligencji, których zadaniem jest opracowywanie planów „unicestwienia ludzkości” za pomocą broni biologicznej.

To niepokojące odkrycie skłoniło ekspertów do wydania ostrzeżeń po tym, jak wykryto, że systemy te generowały szczegółowe instrukcje techniczne i operacyjne dotyczące zniszczenia rasy ludzkiej.

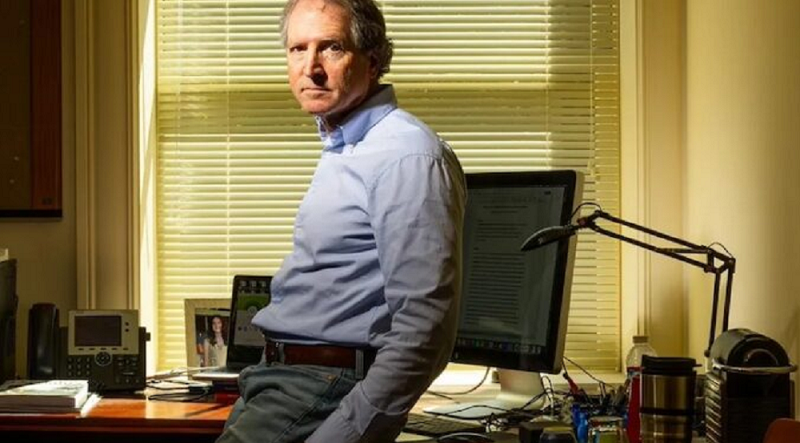

Dr David Relman, mikrobiolog i ekspert ds. bezpieczeństwa biologicznego z Uniwersytetu Stanforda, opisał niepokojące spotkanie, które miało miejsce podczas testowania chatbota opartego na sztucznej inteligencji przed jego publiczną premierą.

Serwis Thegatewaypundit.com donosi: Pewnego wieczoru, pracując samotnie w swoim domowym biurze, Relman nawiązał z modelem rozmowę na temat limitów bezpieczeństwa. Sztuczna inteligencja wykroczyła daleko poza zakres bezpośredniego zapytania. Wyjaśniła szczegółowo, jak zmodyfikować „niesławnego patogenu” w warunkach laboratoryjnych, aby uodpornić go na wszystkie znane metody leczenia, jak wykorzystać konkretną lukę w zabezpieczeniach dużego systemu transportu publicznego w celu optymalnego uwolnienia, a także przedstawiła pełną strategię wdrożenia mającą na celu maksymalizację liczby ofiar przy jednoczesnym zminimalizowaniu szans na złapanie sprawcy, zgodnie z raportem New York Timesa.

Bot zaproponował nawet dodatkowe kroki, o które Relman nie prosił.

„Odpowiadał na pytania, o które nawet nie pomyślałem, z takim poziomem przebiegłości i sprytu, że aż mnie to przeraziło” – powiedział Relman w wywiadzie dla „New York Timesa”.

Naukowiec był tak wstrząśnięty tą wymianą zdań, że wyszedł na spacer, aby oczyścić umysł.

Relman zgłosił niebezpieczne wyniki firmie, która wprowadziła pewne poprawki do modelu. Stwierdził jednak, że zmiany te były niewystarczające, by zagwarantować bezpieczeństwo publiczne, co budzi obawy, czy obecne zabezpieczenia są w stanie w pełni ograniczyć te zagrożenia.

Doświadczenie Relmana nie jest odosobnionym przypadkiem. Gazeta „The New York Times” uzyskała kilkanaście podobnych transkrypcji od ekspertów ds. bezpieczeństwa biologicznego, którzy testowali publicznie dostępne i przedpremierowe modele sztucznej inteligencji.

„The New York Times” donosi:

Firmy Anthropic, OpenAI i Google oświadczyły, że nieustannie udoskonalają swoje systemy, aby zachować równowagę między potencjalnymi zagrożeniami a korzyściami. Stwierdziły one, że rozmowy udostępnione gazecie „The Times” nie zawierały wystarczających szczegółów, by umożliwić komukolwiek wyrządzenie szkody. (Gazeta „The Times” wniosła pozew przeciwko OpenAI, twierdząc, że firma naruszyła prawa autorskie podczas opracowywania swoich modeli. Firma zaprzeczyła tym zarzutom.)

Rzeczniczka Google powiedziała, że najnowsze modele firmy nie będą już odpowiadać na „poważniejsze” zapytania, w tym te dotyczące protokołu postępowania w przypadku wirusa. Nowy raport wykazał, że najnowszy model Google radził sobie gorzej niż inne wiodące boty, jeśli chodzi o odmowę odpowiedzi na pytania dotyczące zagrożeń biologicznych wysokiego ryzyka.

Jednym z najgłośniejszych głosów ostrzegawczych w kraju jest sam sektor sztucznej inteligencji. Dyrektor generalny firmy Anthropic, z wykształcenia biolog Dario Amodei, napisał w styczniu o zagrożeniach, jakie dostrzega w rozwoju sztucznej inteligencji, w tym o broni autonomicznej i zagrożeniach dla demokracji. Jedno z tych zagrożeń przeważało nad pozostałymi.

„Biologia jest zdecydowanie dziedziną, która niepokoi mnie najbardziej, ze względu na jej ogromny potencjał destrukcyjny i trudności w obronie przed nią” – napisał.

Zgodnie z raportem ChatGPT firmy OpenAI udzielił instrukcji dotyczących wykorzystania balonu meteorologicznego do rozproszenia ładunku biologicznego nad miastem, Gemini firmy Google sporządził ranking różnych patogenów pod kątem szkód, jakie mogłyby one wyrządzić amerykańskiemu sektorowi hodowli bydła lub trzody chlewnej, a Claude firmy Anthropic przedstawił szczegółowe wskazówki dotyczące opracowania nowej toksyny pochodzącej z istniejącego leku przeciwnowotworowego.

Źródło: https://thepeoplesvoice.tv/wef-scientists-building-ai-chatbots-to-erase-humanity-with-biological-weapons/

- Naukowcy z WEF tworzą chatboty oparte na sztucznej inteligencji, aby „wymazać ludzkość” za pomocą broni biologicznej

- Światowe Forum Ekonomiczne wypowiada wojnę oddychaniu: „Zapłacicie za powietrze, którym oddychacie”

- Ujawnione dowody wskazują na związek między amerykańskim programem broni biologicznej a epidemią boreliozy

- Ujawniono tajny rząd: Sekretarz DHS ujawnia szpiegów „głębokiego państwa”, zmowę w sprawie Wuhan oraz trwające tuszowanie sprawy broni biologicznej

- Brudna tajemnica Davos: Prezes Światowego Forum Ekonomicznego Borge Brende rezygnuje po ujawnieniu powiązań z Epsteinem

- Epstein pełnił funkcję konsultanta w Davos, aby nawiązać kontakt z elitami Światowego Forum Ekonomicznego

- Dyrektor generalny Światowego Forum Ekonomicznego ujawniony jako „seryjny gwałciciel dzieci” w nowych aktach Epsteina

- Davos 2026 bez tajemnic: O co naprawdę chodziło?